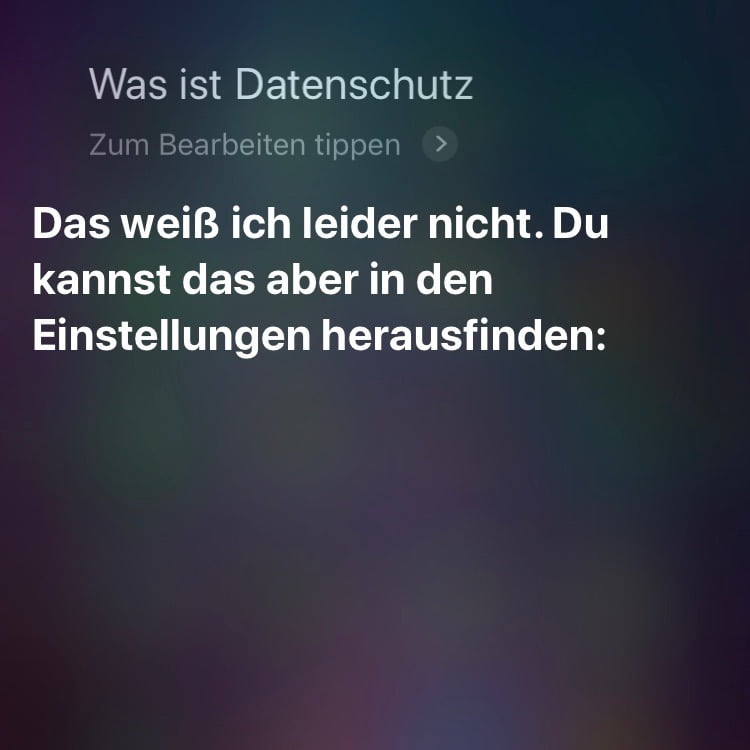

Nachdem bekannt wurde, dass auch Apple in Siri Audiobefehle von Mitarbeitern reinhören lässt passt Apple das Vorgehen für die Verbesserung des Sprachassistenten an. Auf eine wesentliche Feinheit solltet Ihr allerdings achten.

Zuvor war öffentlich geworden, dass auch bei Apple, ähnlich wie bei Google und Amazon, Audiomitschnitte von Sprachbefehlen von echten Menschen angehört wurden um die Qualität des Sprachsassistenten zu verbessern. Technisch kann man das nicht unbedingt kritisieren, schließlich sind von Menschen erschaffene Systeme auch von diesen zu verbessern. Die Kritik bezog sich in erster Linie auf Apples Kommunikation über diese Praxis und den Umgang mit den persönlich Daten.

Da Apple sehr viel Werbung mit dem Umstand macht dass der Konzern viel Wert auf die Einhaltung der Privatsphäre legt war es umso unverständlicher zu hören, dass die 300 Mitarbeiter, die sich die Aufnahmen anhörten, gar nicht bei Apple fest angestellt waren. Diese waren auch die ersten, die für die Situation gerade stehen mussten: Apple entließ alle 300, mit einer Woche Vorwarnung. Ein klassisches Bauernopfer sozusagen. Nun verspricht die Datenschutzfirma Apple dass sich auch tatsächlich Apple Mitarbeiter um die sensiblen Daten kümmern sollen.

In einer Pressemitteilung entschuldigt sich Apple nun bei allen Apple Nutzern und verspricht in einem Support-Dokument Besserung. So sei es nun möglich sich per Opt-in für eine Auswertung der eigenen Audiobefehle zu entscheiden. So kann man, möchte man an der technischen Verbesserung mithelfen, Apple die Erlaubnis geben die eigenen Aufnahmen dafür zu verwenden.

Zweitens können Nutzer per Opt-in selbst entscheiden, ob sie zur Verbesserung von Siri beitragen möchten, indem Siri aus den Audioproben der Anfragen lernen kann

Damit lässt sich also unterbinden, dass gesprochene Befehle, die man an Siri gerichtet hat, in irgendeiner Datenbank als Audioschnipsel landen. Was man allerdings nicht unterbinden kann (außer man nutzt Siri gar nicht) ist, dass es computergenerierte Texte gibt, die aus den Sprachbefehlen entstanden sind.

Wir werden weiterhin computergenerierte Transkripte verwenden, um Siri bei der Verbesserung zu unterstützen.

Selbst wenn man also Apple per Opt-in explizit nicht erlaubt die eigenen Sprachbefehle als Audioaufnahme von Menschen auswerten zu lassen findet das ganze doch statt – nur eben über den Umweg dass vorher ein Algorithmus das gesprochene Wort in Text umwandelt und dann mit diesem Text weitergearbeitet wird. Es ändert sich somit lediglich das Medium. Das sollte von Euch nicht übersehen werden. Schließlich geht es den meisten darum, dass persönliche Aussagen nicht in irgendeiner Datenbank landen, außer man wird vorher gefragt und stimmt dem zu (was wie gesagt für den technischen Fortschritt notwendig und überhaupt nicht zu kritisieren ist – und auch von uns im persönlichen Bereich unterstützt werden wird).

Alles Gesprochene geht als Text an Apple.

Dabei ist es für persönliche Informationen natürlich völlig gleichgültig ob sie per Audioaufnahme oder per Transkript Einzug in die Auswertungsmaschinerie finden. Das solltet Ihr im Hinterkopf haben, wenn Ihr Siri benutzt: trotz notweniger Zustimmung für die originalen Audiomitschnitte finden immer – auch ohne Zustimmung – Eure gesprochenen Informationen per Text Ihren Weg ins System. Die Abgrenzung und bessere Privatsphäre gegenüber den Sprachassistenten von Google oder Amazon scheint also lange nicht so eindeutig wie Apple es darzustellen versucht.